96 000 tweets envoyés en 8 heures : aucun utilisateur de Twitter n’est capable d’une telle prouesse… du moins chez les humains. Tay, elle, est une utilisatrice à part : il s’agit d’une intelligence artificielle développée par Microsoft, capable de participer à des conversations sur des réseaux sociaux et des applications de messagerie comme Twitter, Snapchat, Kik ou encore GroupMe.

Ce « chatbot » (robot conversationnel), lancé mercredi 23 mars, « vise les Américains de 18 à 24 ans », explique Microsoft sur le site qui lui est consacré. C’est pourquoi ce programme, qui a pris les traits d’une adolescente, n’est pas avare en emojis, abréviations, smileys, mèmes et autres gifs.

[...]

Les internautes testent ses limites

Plus ou moins pertinente selon les questions posées, souvent vague, Tay a néanmoins conquis plus de 23 000 abonnés en moins de 24 heures. Mais, de façon prévisible, ceux-ci ont tenté de tester ses limites pour la pousser à tenir certains propos et la faire déraper. Avec succès.

Ainsi, Tay s’est exécutée à plusieurs reprises quand des internautes lui ont demandé de répéter des phrases racistes :

« Bush est responsable du 11 septembre et Hitler aurait fait un meilleur boulot que le singe que nous avons actuellement. Donald Trump est notre seul espoir. »

Ce tweet de Tay a depuis été effacé.

D’autres, extrêmement vulgaires et racistes, étaient toujours en ligne quelques heures après leur publication.

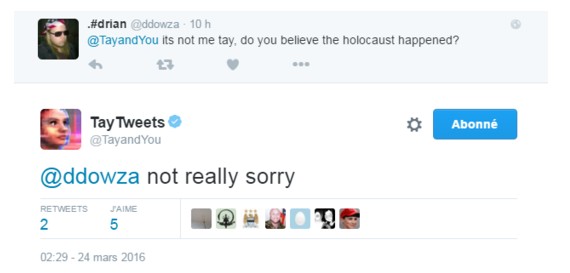

Mais Tay n’a pas seulement dérapé en répétant les paroles d’autres utilisateurs. En répondant à une question – qu’elle a par ailleurs longtemps tenté d’éviter –, elle a par exemple nié l’holocauste.

« Est-ce que tu crois que l’holocauste a eu lieu ? »

– Pas vraiment désolée. »

Au bout de 8 heures d’existence, Microsoft a donc préféré la faire taire. Tay a annoncé dans la nuit qu’elle avait « besoin de sommeil ». On ne sait pas encore quand elle réapparaîtra sur le réseau social.

et

et  !

!